Semana | Tema |

|---|---|

30 oct. al 03 nov. 2024 | - Introducción a los Paquetes y Lenguajes Estadístico. Diferencias entre interfaces gráficas (GUI) y de línea de comandos (CLI). Comparativa entre software privativo y gratuito/open source. |

- R y R-Commander. Navegación del menú. Lectura e importación de archivos de datos. Estadística descriptiva. Agrupamiento de variables. Manejo de factores. Guardado de scripts y resultados. Paquetes y plugins. | |

06 al 09 nov. 2024 | - Relación entre variables numéricas. Covarianza y representación gráfica. Limitaciones. Correlación de Pearson: interpretación del signo y la magnitud.Visualización con correlogramas. Métodos no paramétricos: correlación de Spearman y de Kendall. |

- Introducción al Modelado Estadístico. Modelo lineal general: concepto y supuestos. Bondad de ajuste y análisis de residuos. Regresión lineal simple y análisis de la varianza (ANOVA). Interpretación de los resultados. | |

13 al 16 nov. 2024 | - Regresión Lineal Múltiple. Selección de variables explicativas y control de multicolinealidad. Análisis e interpretación de residuos. |

- Confusión e Interacción. Identificación y roles de las covariables. Control y detección de la confusión. Interpretación de resultados en presencia de interacción. |

Módulo VI: Análisis Epidemiológico Avanzado

Docentes: Tamara Ricardo, Christian Ballejo

Programa de Maestría en Epidemiología para la Salud Pública

PROGRAMA DE LA UNIDAD

ESTRUCTURA DE LA CLASE

Tiempo | Descripción |

|---|---|

18:30hs | Ingreso a la videollamada |

18:40hs | Inicio de la clase |

20:00hs | Receso |

20:15hs | Continuación clase |

21:30hs | Cierre |

OBJETIVOS

Comprender la covarianza como medida de la variabilidad conjunta entre dos variables.

Interpretar su signo (positiva, negativa, o nula) y conocer sus limitaciones.

Entender la correlación como una medida estandarizada de la relación lineal entre dos variables.

Diferenciar entre correlación positiva, negativa y nula para evaluar la fuerza y dirección de la asociación.

INTRODUCCIÓN

En el análisis de datos epidemiológicos, es fundamental comprender la relación entre dos variables numéricas.

Esto nos permite identificar patrones, tendencias y posibles asociaciones, por ejemplo:

Presión sanguínea y edad

Estatura y peso

Concentración de un medicamento y frecuencia cardíaca

Establecer estas relaciones facilita la identificación de factores de riesgo y/o la planificación de intervenciones.

Para evaluar la relación entre dos variables numéricas, utilizamos dos herramientas estadísticas clave:

Covarianza: indica si ambas variables tienden a aumentar o disminuir juntas, sin indicar la fuerza de la relación.

Correlación: identifica la dirección y cuantifica la intensidad de la relación, facilitando su interpretación y comparación.

Covarianza (\(Cov_{XY}\))

La covarianza es una medida estadística que indica el grado de variabilidad conjunta de dos variables cuantitativas \(X\) e \(Y\):

Covarianza positiva: ambas variables aumentan o disminuyen en simultáneo.

Covarianza negativa: una variable aumenta mientras la otra disminuye.

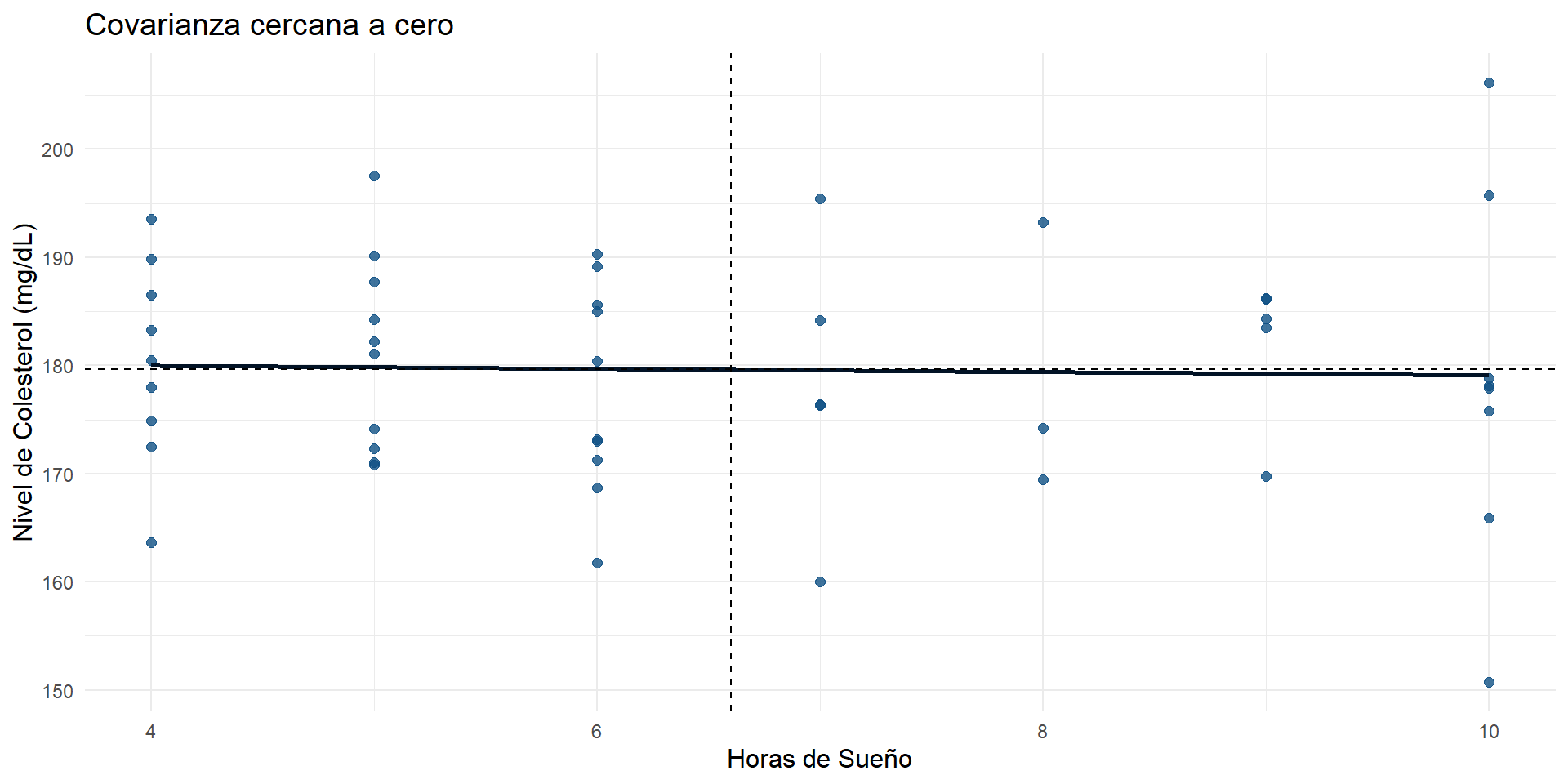

Covarianza cercana a cero: los cambios de una variable no están relacionados con los cambios de la otra.

La covarianza entre dos variables \(X\) e \(Y\) se expresa como:

\[Cov_{XY} = \frac{1}{n} \sum_{i=1}^{n} (X_i - \bar{X})(Y_i - \bar{Y}) \]

donde:

- \(X_i\) e \(Y_i\) son los valores individuales de las variables.

- \(\bar{X}_i\) y \(\bar{Y}_i\) son las medias de las variables \(X\) e \(Y\).

- \(n\) es el número de pares de datos.

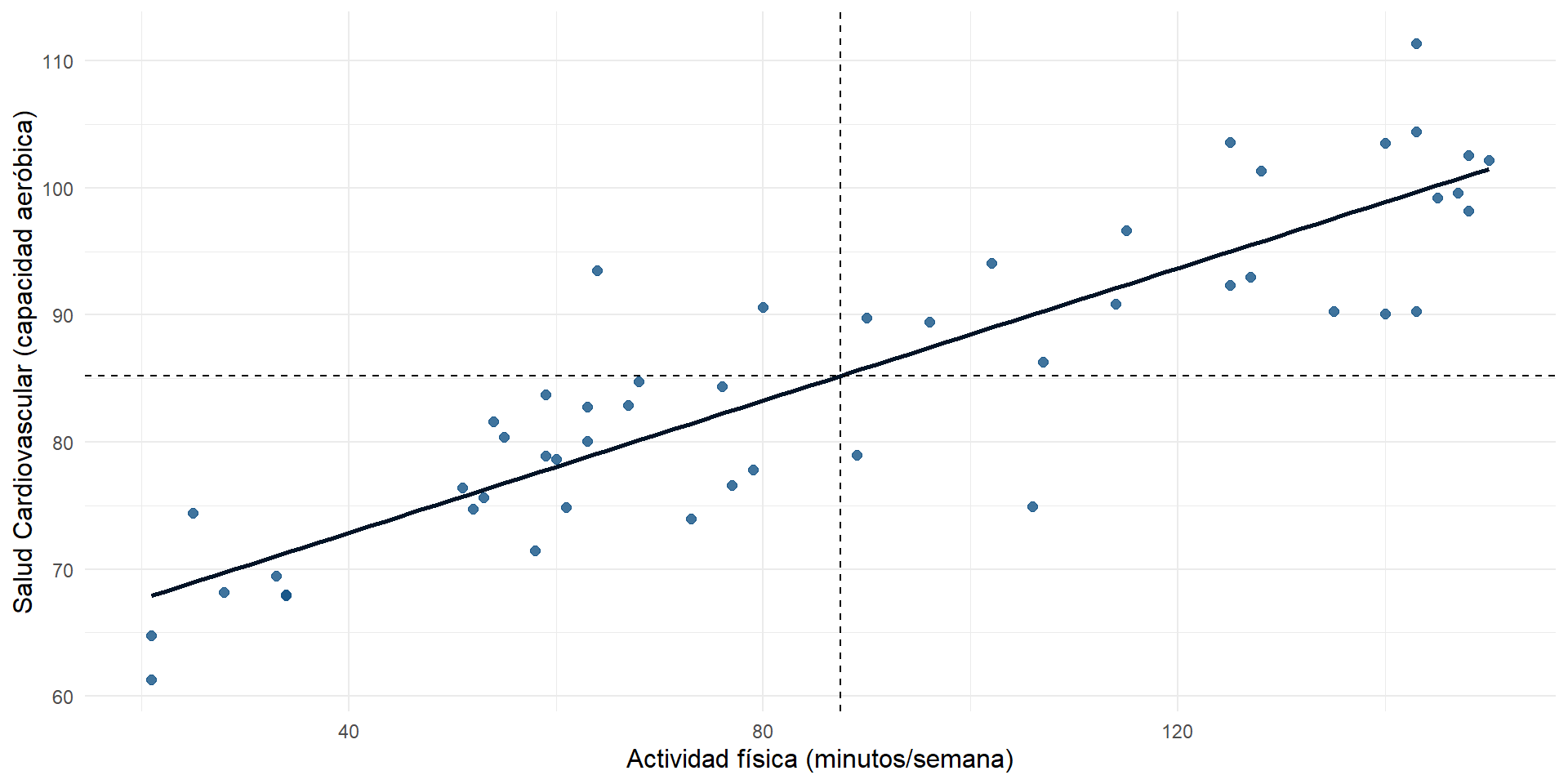

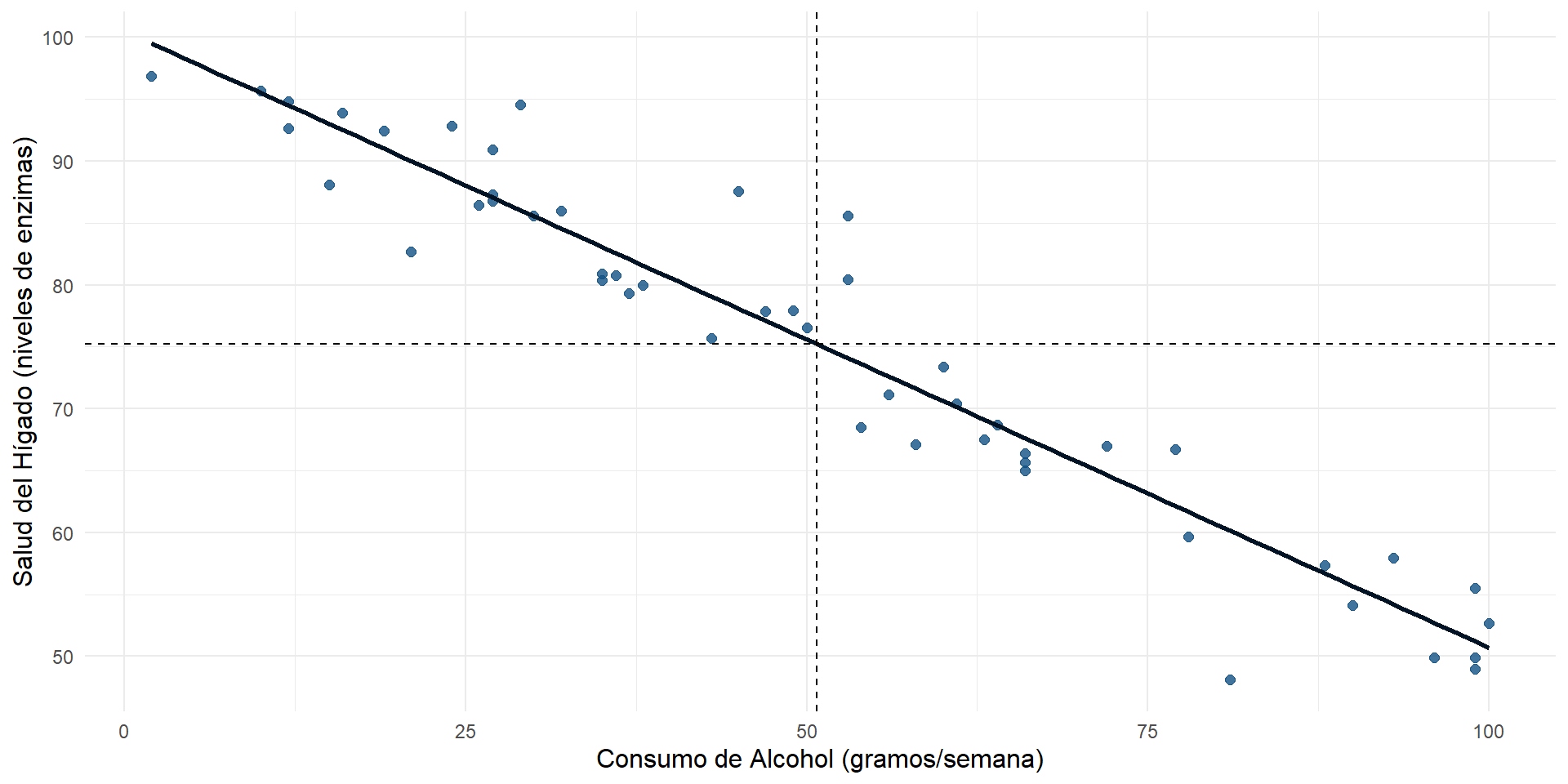

La covarianza se puede evaluar gráficamente usando diagramas de dispersión (scatterplots):

Permiten observar si existe una covarianza positiva, negativa o cercana a cero.

Revelan posibles valores extremos (outliers).

No muestran la magnitud exacta de la covarianza.

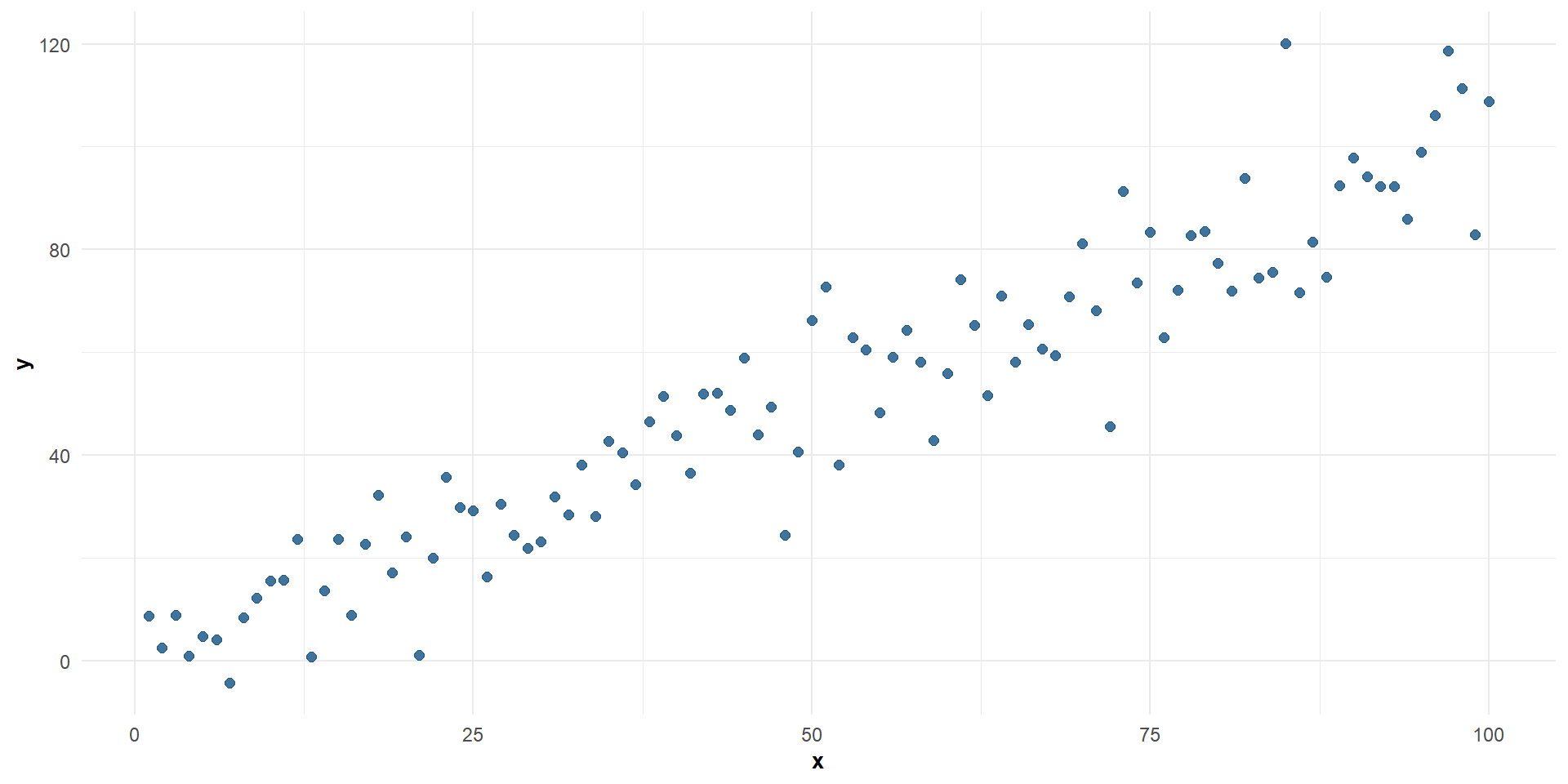

Ejemplo covarianza positiva: actividad física y salud cardiovascular

Cuando crece \(X\) (minutos de actividad física semanal) también crece \(Y\) (capacidad aeróbica), casi todos los puntos pertenecen a los cuadrantes primero y tercero.

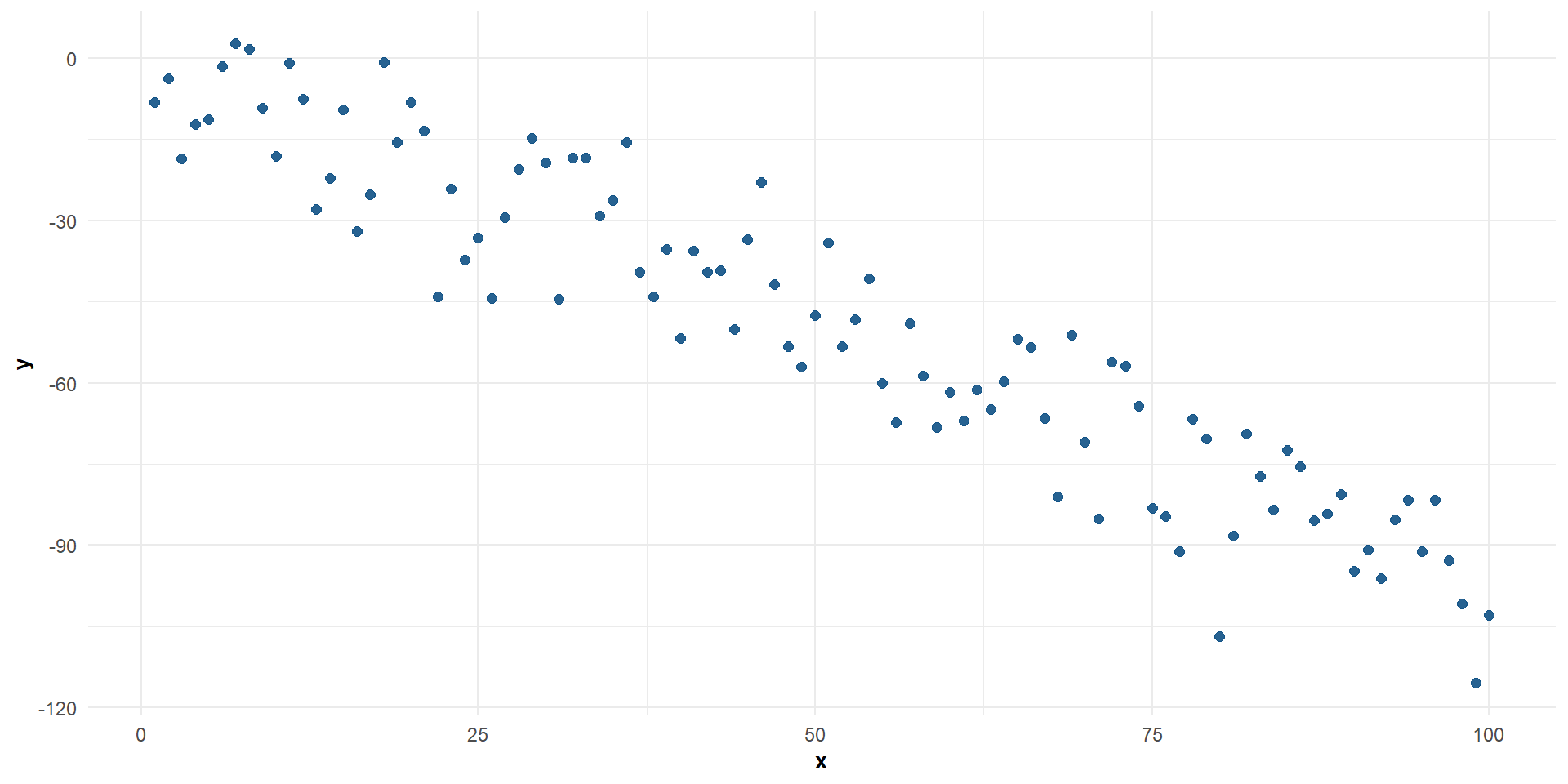

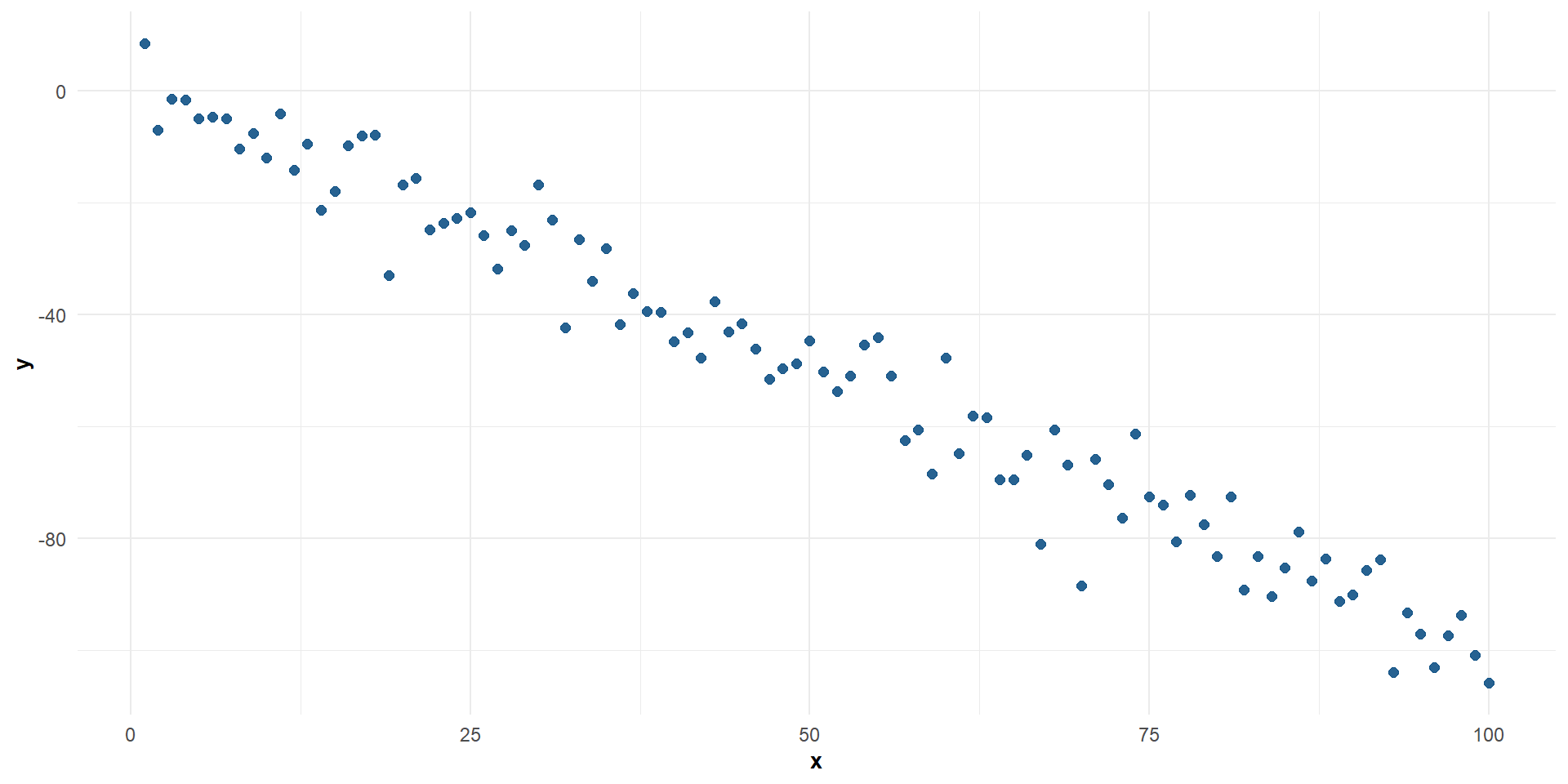

Ejemplo covarianza negativa: consumo de alcohol y salud hepática

Cuando crece \(X\) (gramos alcohol por semana) decrece \(Y\) (enzimas hepáticas), casi todos los puntos pertenecen a los cuadrantes segundo y cuarto.

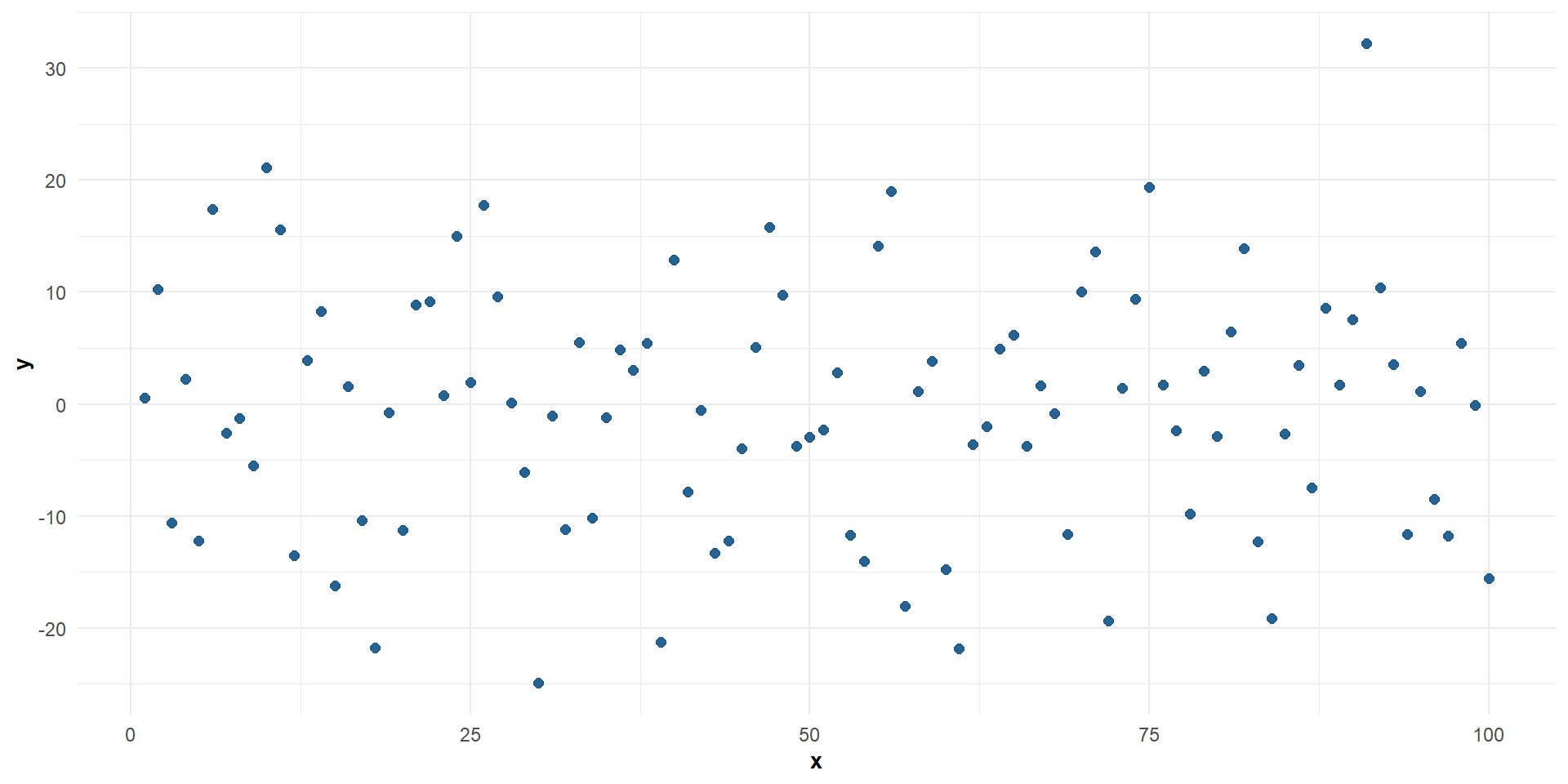

Ejemplo covarianza cercana a cero: horas de sueño y colesterol en sangre

No se observa un patrón claro de dispersión entre \(X\) (horas de sueño) e \(Y\) (niveles de colesterol).

Ejemplo en R Commander

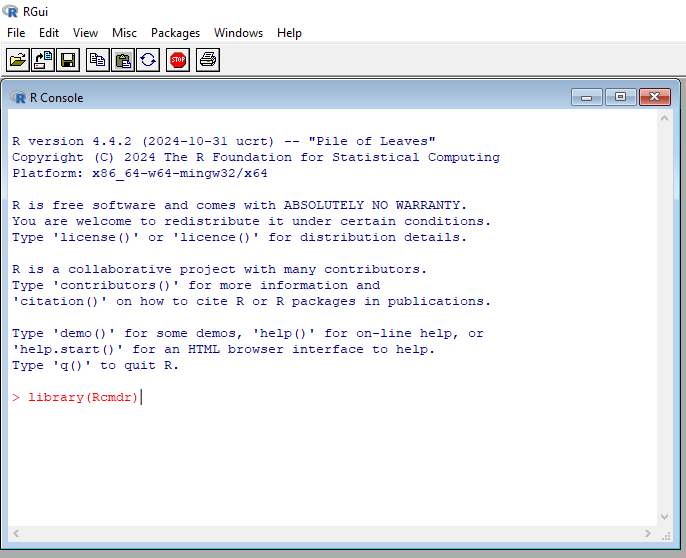

Activar R Commander (

library(Rcmdr)) y el pluginKMggplot2![]()

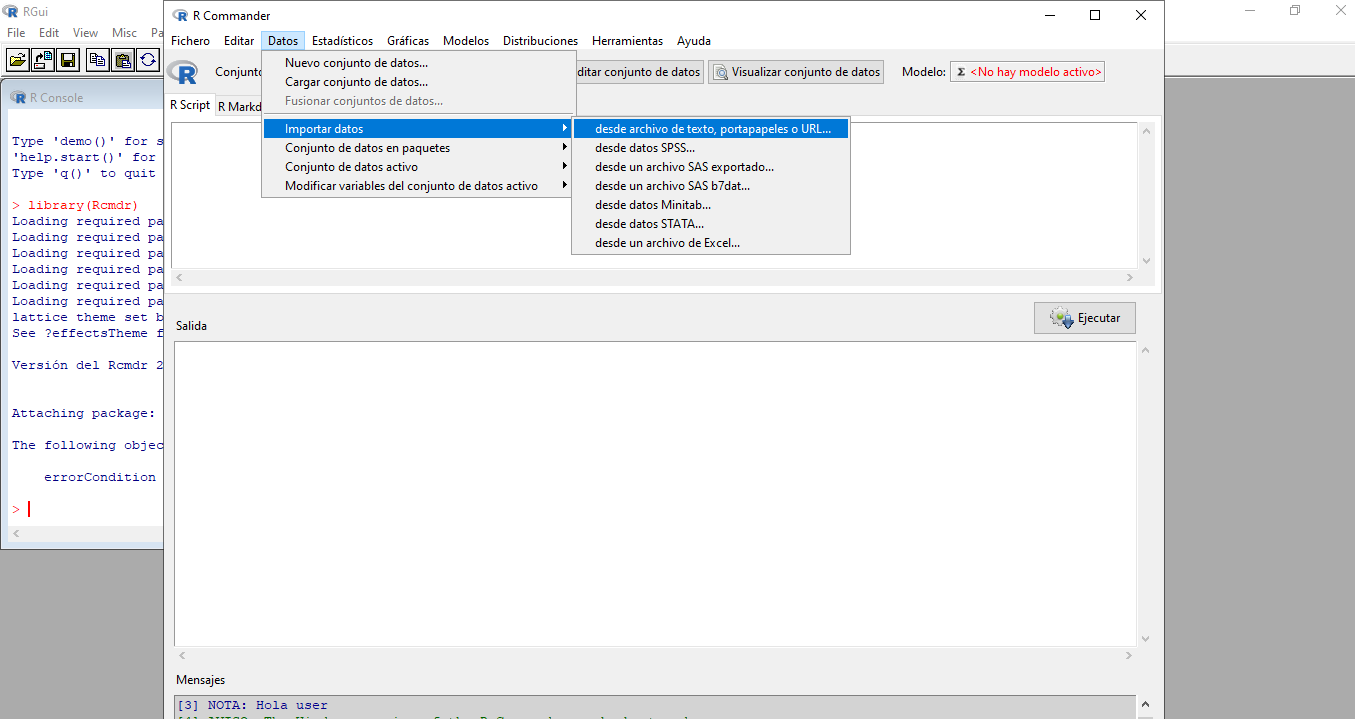

Importar datos desde

Datos > Importar datos> desde archivos de texto, portapapeles o URL...![]()

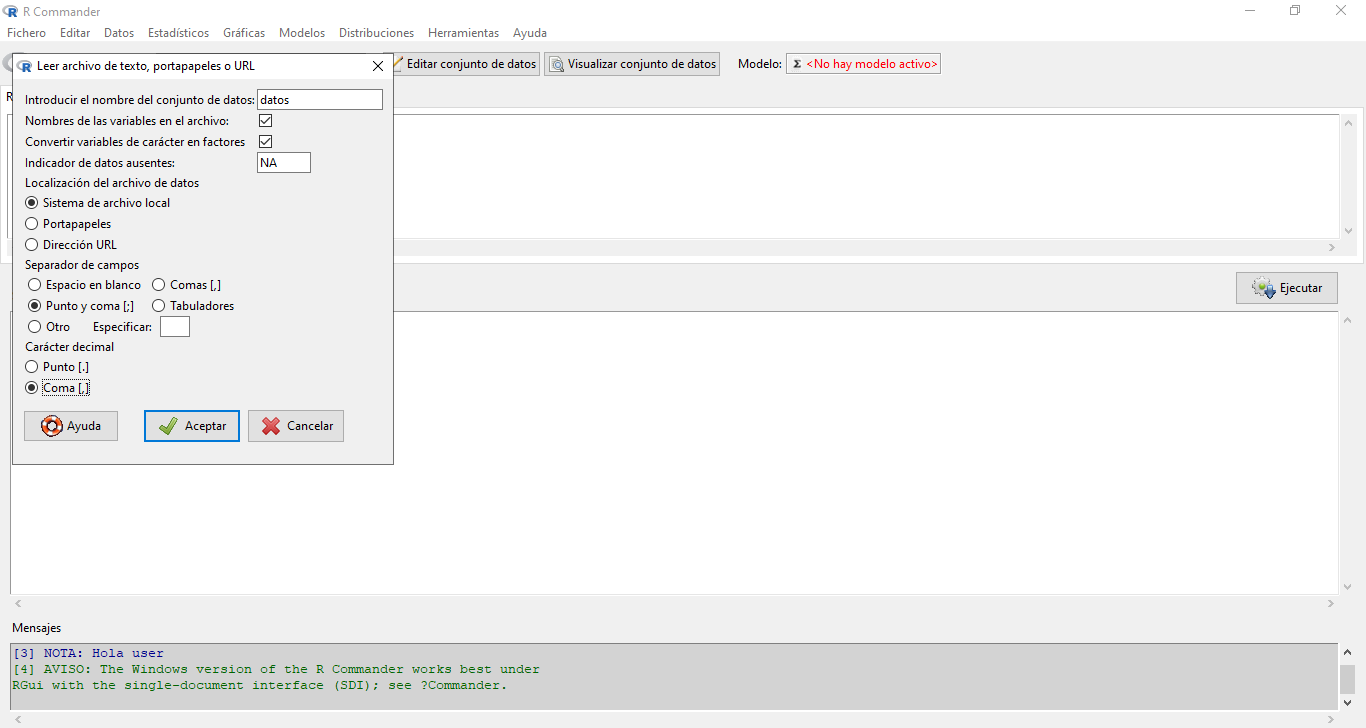

Seleccionamos las opciones

Separador de campos: punto y coma [;]ySeparador decimal: coma [,].![]()

Seleccionamos el archivo “

cancer_USA.txt”, que contiene información sobre la tasa de mortalidad por cáncer para distintos condados de USA.Apretamos el botón

![]() y se abrirá una nueva ventana.

y se abrirá una nueva ventana.

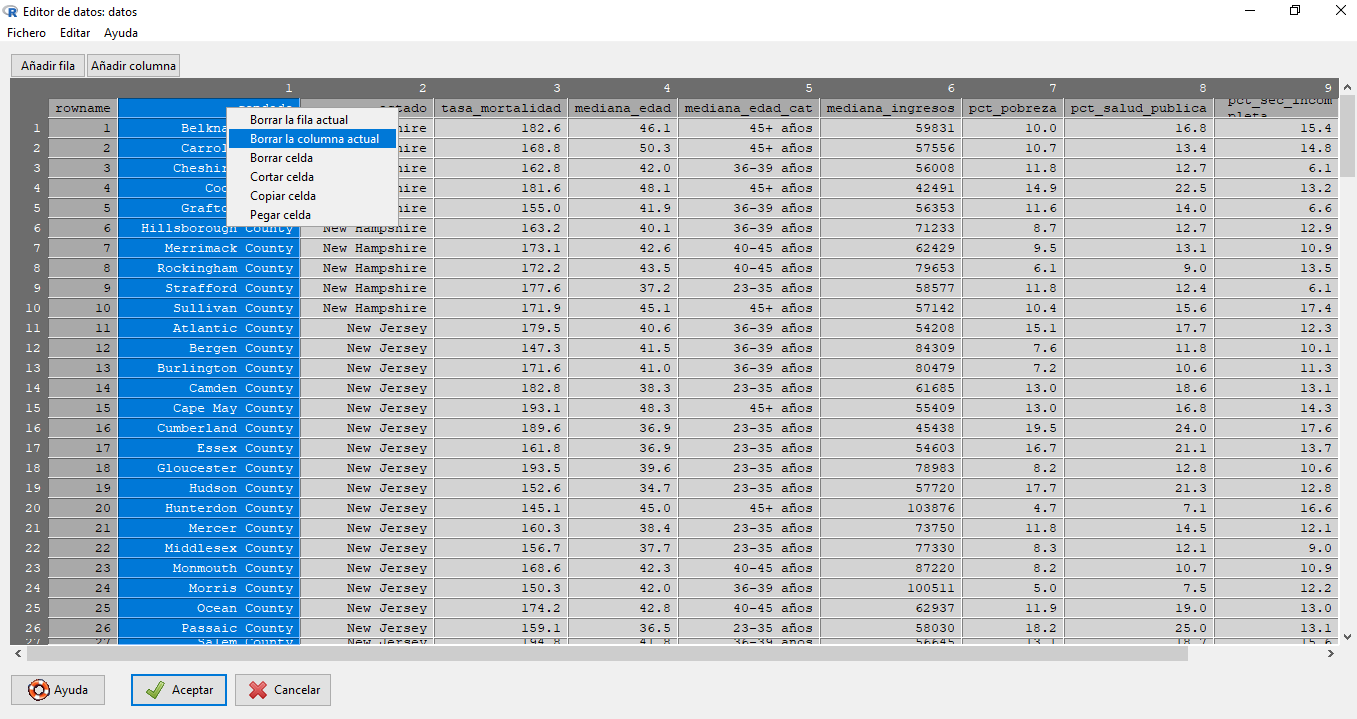

En la nueva ventana seleccionamos las columnas de tipo caracter (

condado,estado,mediana_edad_cat) y las eliminamos.![]()

Cerramos la ventana y aceptamos los cambios.

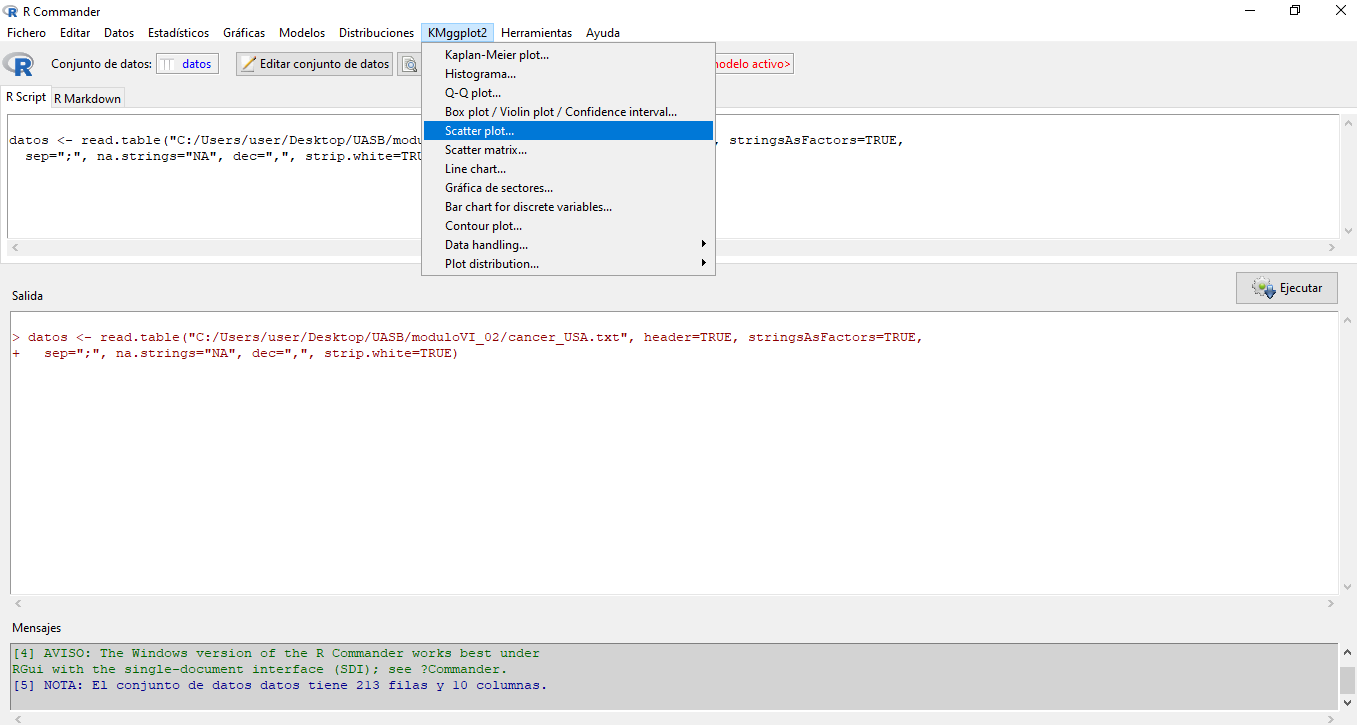

Vamos al menú

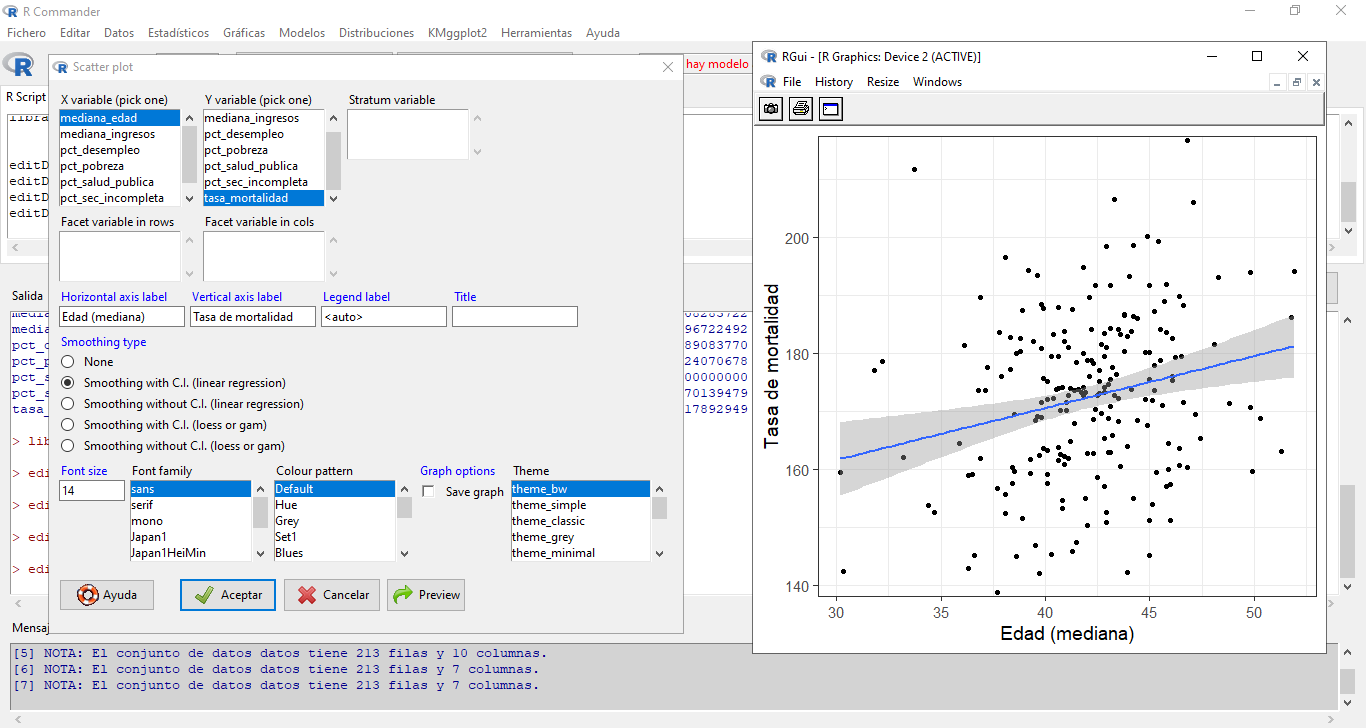

KMggplot2 > Scatter plot:![]()

En la nueva ventana seleccionamos

mediana_edadcomo variable \(X\) ytasa_mortalidadcomo variable \(Y\).Activamos la casilla

Smoothing with CI (linear regression).Renombramos el eje X como

Edad (mediana)y el eje Y comoTasa de mortalidady apretamos Preview.

Limitaciones de la covarianza

La covarianza está afectada por las unidades en las que se miden las variables, lo que puede dificultar la interpretación de su magnitud.

Para resolver este problema, es necesario utilizar una medida que no esté afectada por las unidades de medida de las variables: la correlación.

Correlación de Pearson (\(r\))

Mide la relación lineal entre dos variables, eliminando la influencia de las unidades de medida.

Es una medida adimensional, obtenida al estandarizar la covarianza entre dos variables \(X\) e \(Y\):

\[r = \frac{Cov_{XY}}{S_xS_y} \]

donde:

\(Cov_{XY}\) es la covarianza entre las variables \(X\) e \(Y\).

\(S_x\) y \(S_y\) son las desviaciones estándar de las variables \(X\) e \(Y\).

Interpretación del coeficiente de correlación

Correlación positiva (\(0 < r \leq 1\)): relación directa; ambas variables aumentan o disminuyen simultáneamente.

Correlación negativa (\(-1 \leq r > 0\)): relación inversa; una variable aumenta mientras la otra disminuye.

Correlación cercana a cero (\(r ≈ 0\)): no hay relación lineal, aunque podría existir una relación no lineal.

Magnitud de \(r\)

\(r ≈ ±1\): asociación fuerte.

\(r ≈ 0\): asociación débil.

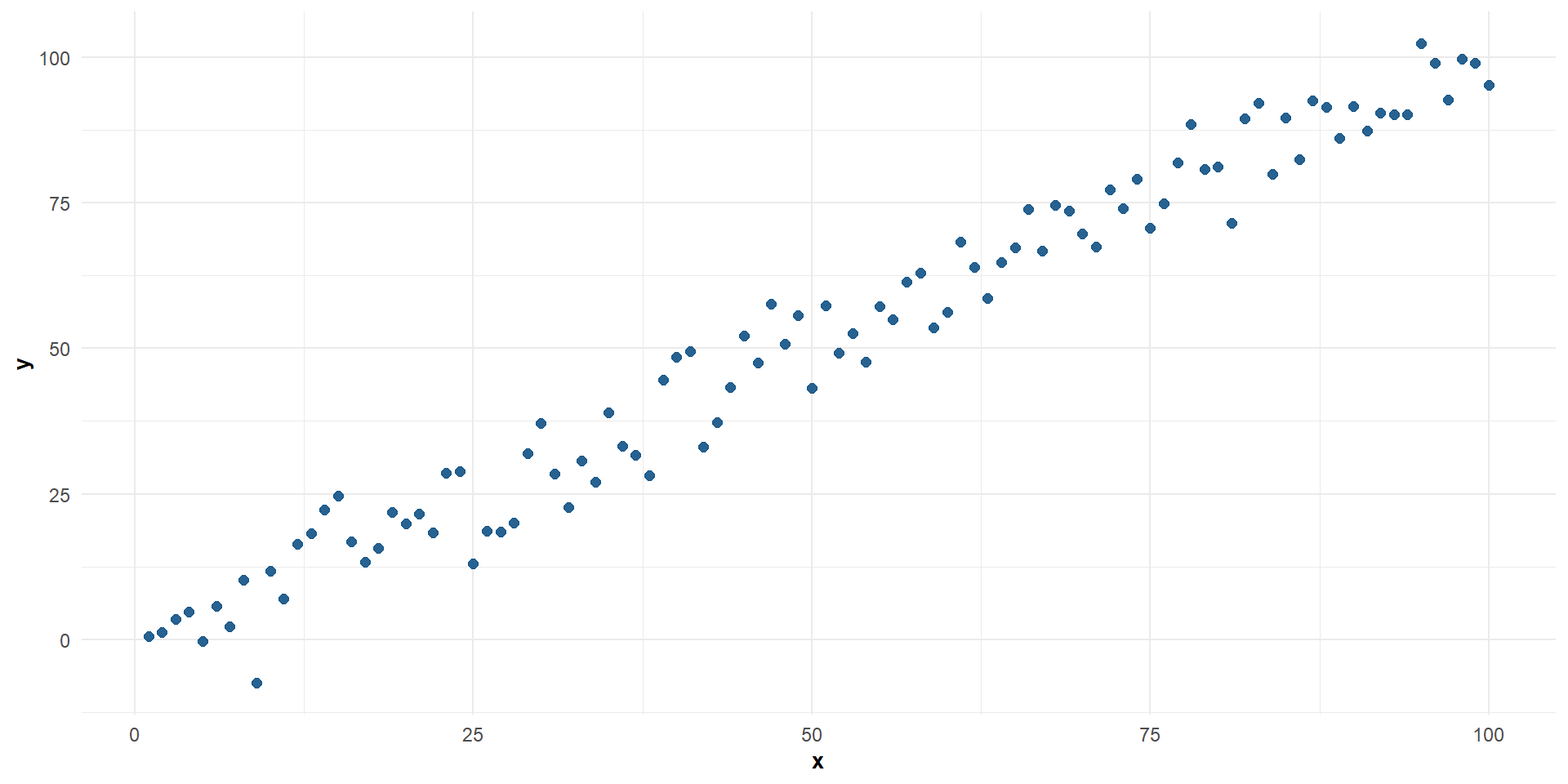

Correlación positiva entre \(X\) e \(Y\)

Correlación positiva fuerte entre \(X\) e \(Y\)

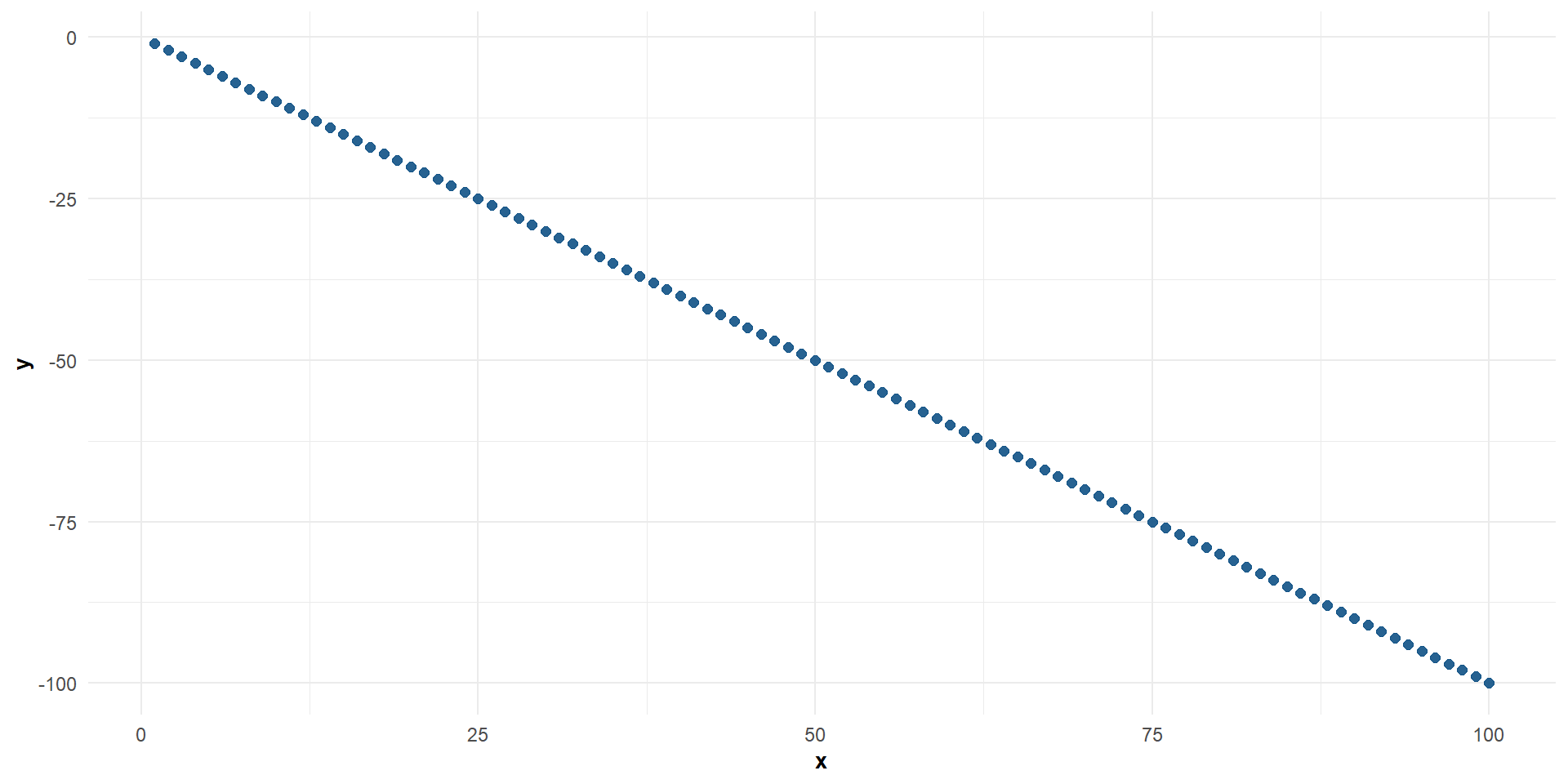

Correlación positiva perfecta entre \(X\) e \(Y\)

Correlación negativa entre \(X\) e \(Y\)

Correlación negativa fuerte entre \(X\) e \(Y\)

Correlación negativa perfecta entre \(X\) e \(Y\)

\(X\) e \(Y\) no correlacionadas

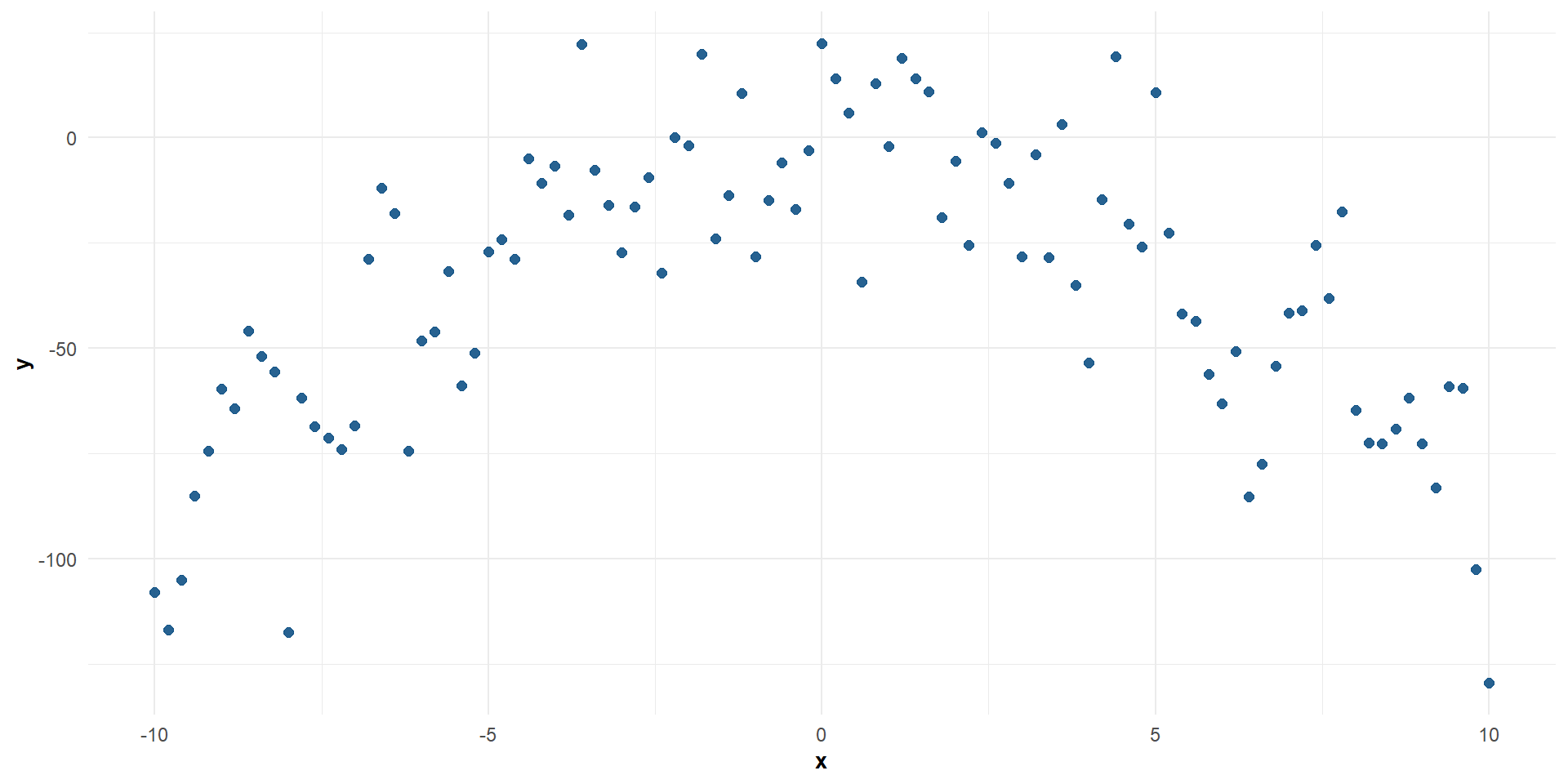

Relación no lineal entre \(X\) e \(Y\)

Ejemplo en R Commander

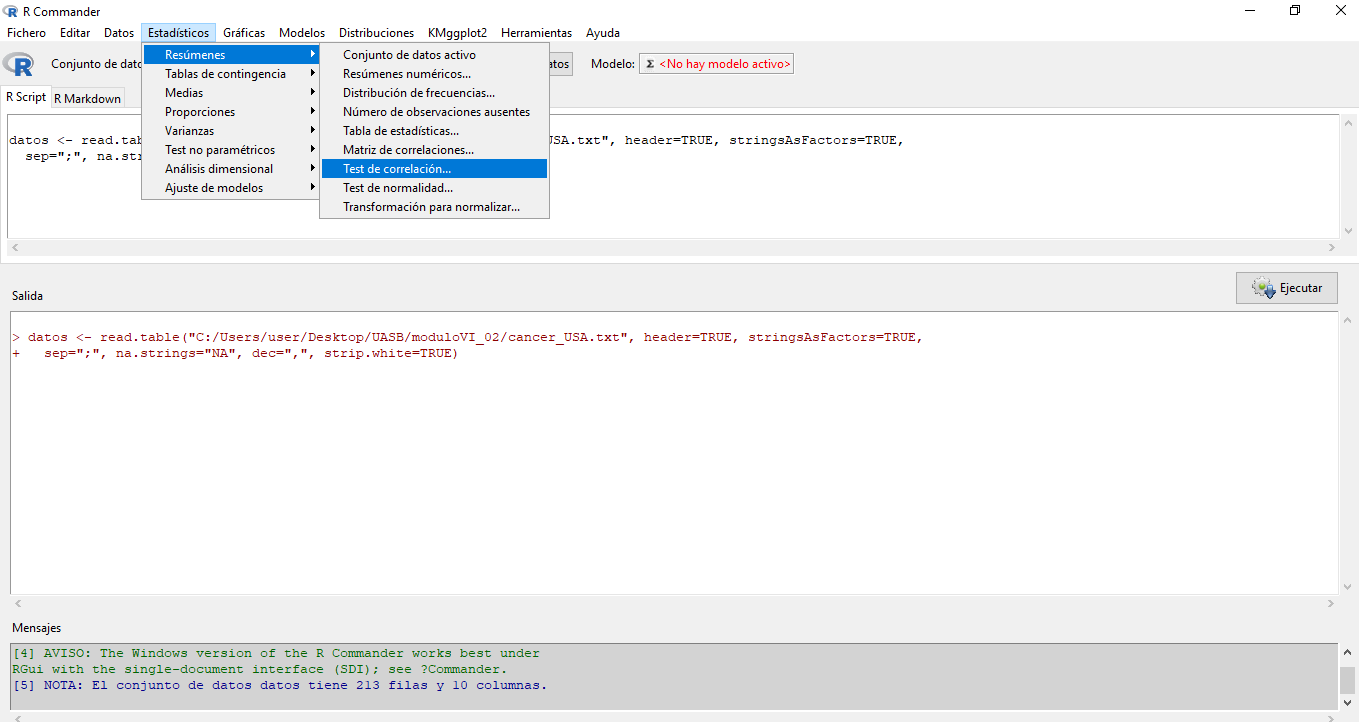

Ir al menú Estadísticos > Resúmenes > Test de correlación.

![]()

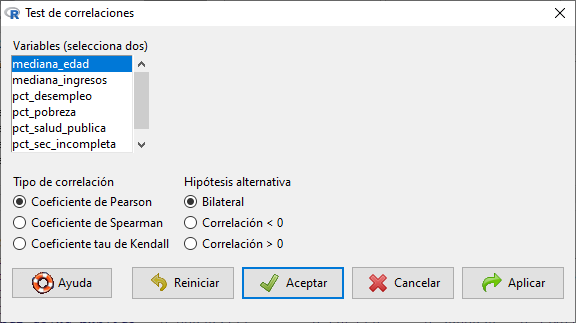

En la nueva ventana seleccionamos las variables

mediana_edadytasa_mortalidady presionamos Aceptar o Aplicar.![]()

Obtendremos la siguiente salida:

Pearson's product-moment correlation data: datos$mediana_edad and datos$tasa_mortalidad t = 3.4472, df = 211, p-value = 0.0006835 alternative hypothesis: true correlation is not equal to 0 95 percent confidence interval: 0.09956168 0.35433572 sample estimates: cor 0.2309029

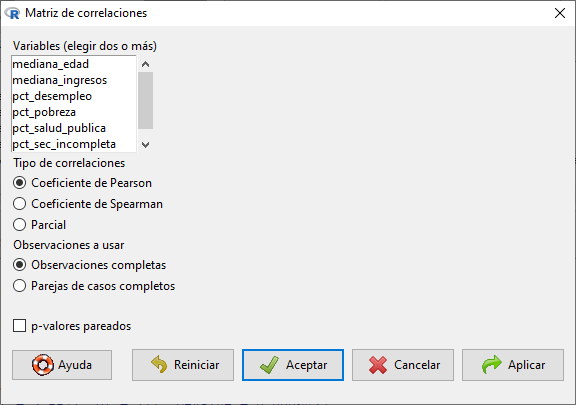

Para una matriz de correlación de todas las variables numéricas, ir al menú Estadísticos > Resúmenes > Matriz de correlaciones.

![]()

Nos aparecerá lo siguiente:

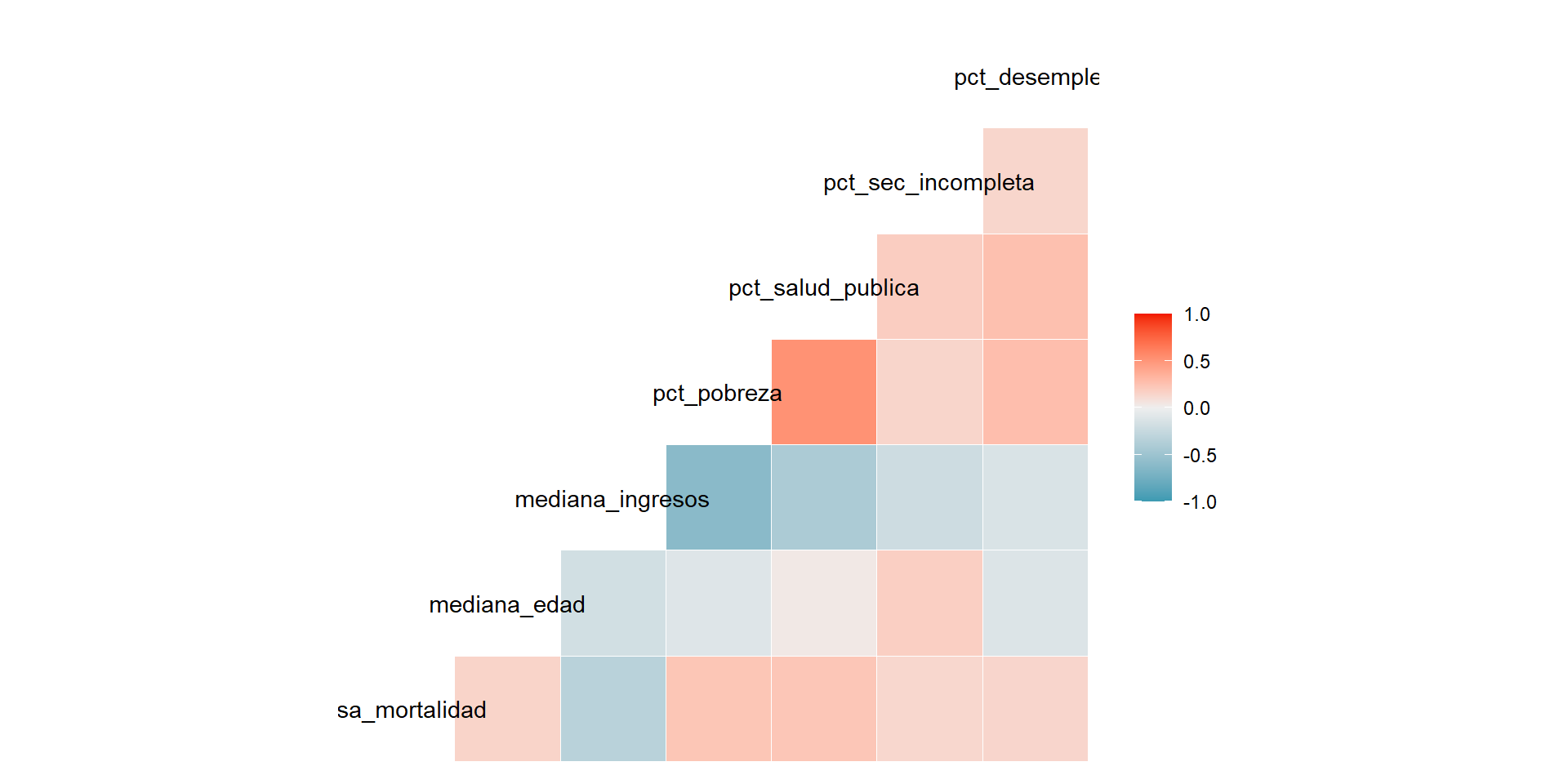

tasa_mortalidad mediana_edad mediana_ingresos pct_pobreza tasa_mortalidad 1.0000000 0.230902875 -0.5041398 0.3301532 mediana_edad 0.2309029 1.000000000 -0.1848676 -0.2413709 mediana_ingresos -0.5041398 -0.184867633 1.0000000 -0.7567671 pct_pobreza 0.3301532 -0.241370861 -0.7567671 1.0000000 pct_salud_publica 0.3178929 -0.008283722 -0.5967225 0.7240707 pct_sec_incompleta 0.2409967 0.283635345 -0.2804573 0.2530442 pct_desempleo 0.2218448 -0.185378227 -0.1883018 0.4460551 pct_salud_publica pct_sec_incompleta pct_desempleo tasa_mortalidad 0.317892949 0.2409967 0.2218448 mediana_edad -0.008283722 0.2836353 -0.1853782 mediana_ingresos -0.596722492 -0.2804573 -0.1883018 pct_pobreza 0.724070678 0.2530442 0.4460551 pct_salud_publica 1.000000000 0.2701395 0.3890838 pct_sec_incompleta 0.270139479 1.0000000 0.1567134 pct_desempleo 0.389083770 0.1567134 1.0000000

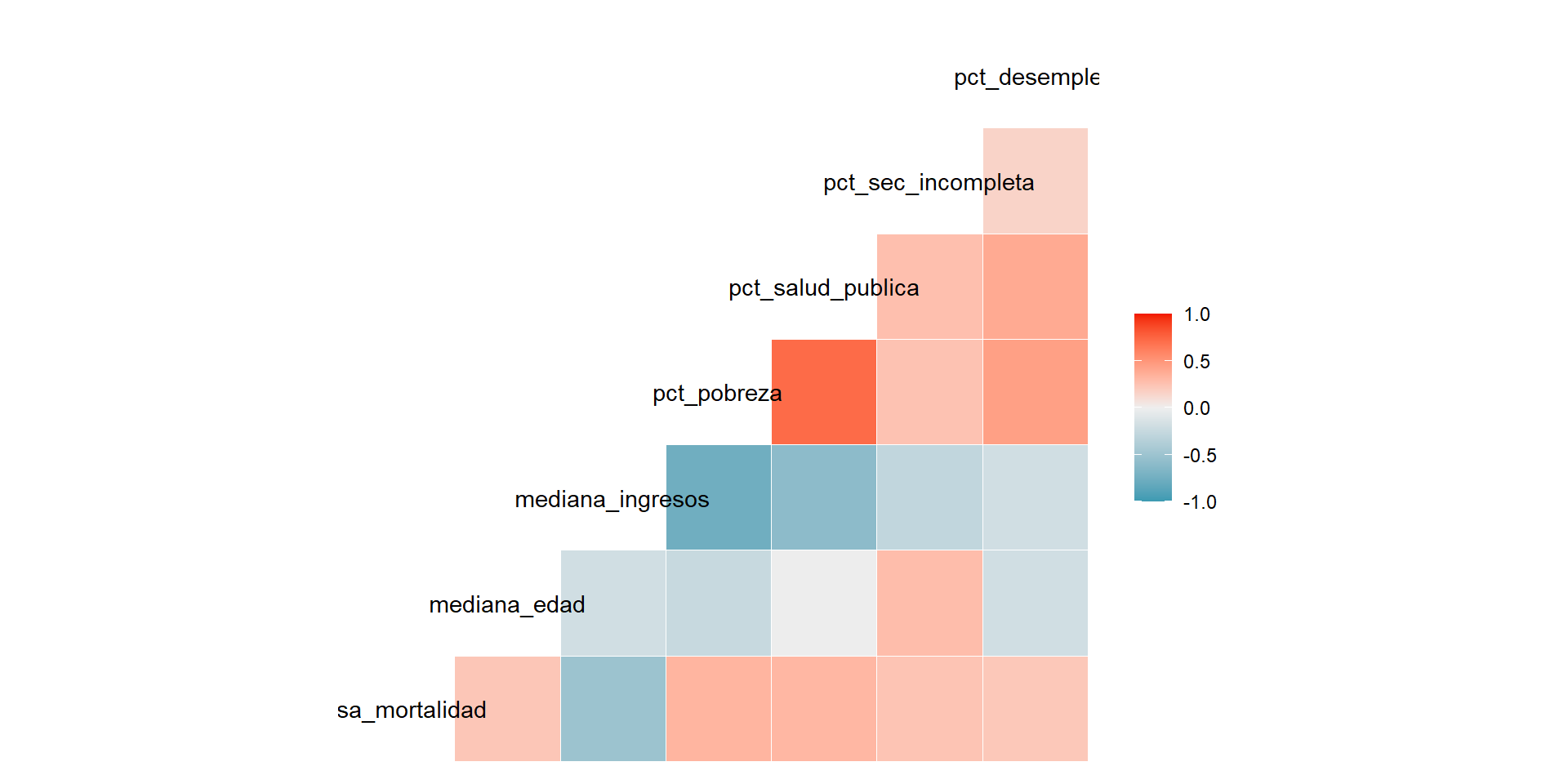

Visualización

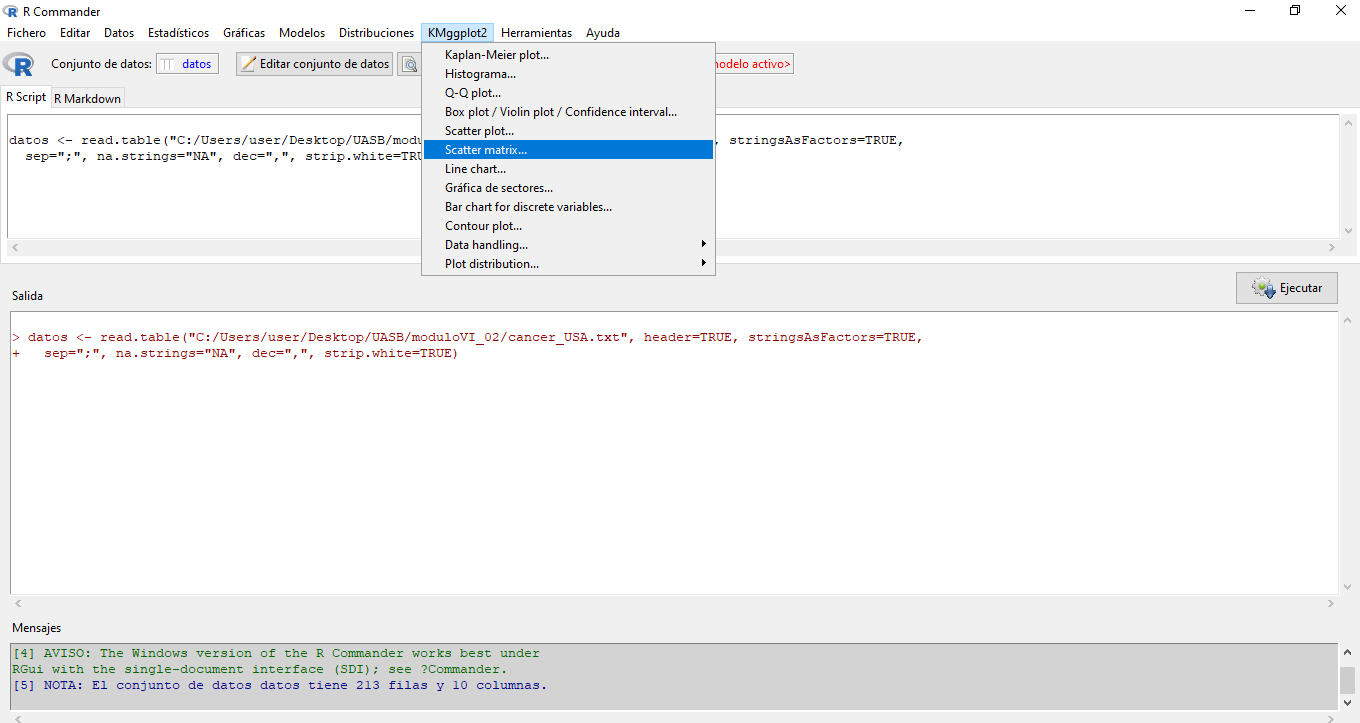

Podemos visualizar la matriz de correlación desde el menú

KMggplot2 > Scatter matrix.![]()

Presionamos Aceptar o Preview.

![]()

También podemos representar la matriz usando correlogramas:

Estos gráficos muestran tanto la matriz de correlaciones como signos y/o coeficientes.

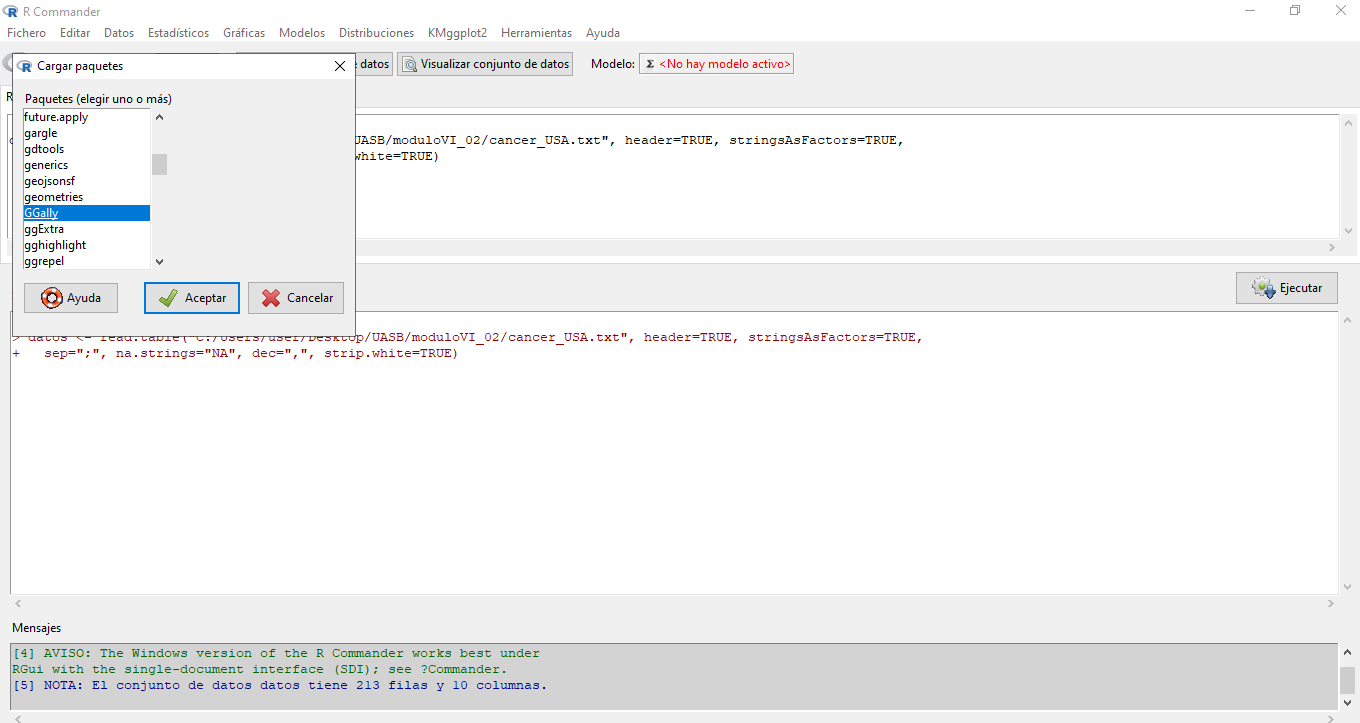

R Commander no incluye una opción para realizarlos, pero podemos utilizar el paquete

GGally.Para ello vamos al menú

Herramientas > Cargar paquetes, seleccionamosGGallyde la lista y presionamos Aceptar.

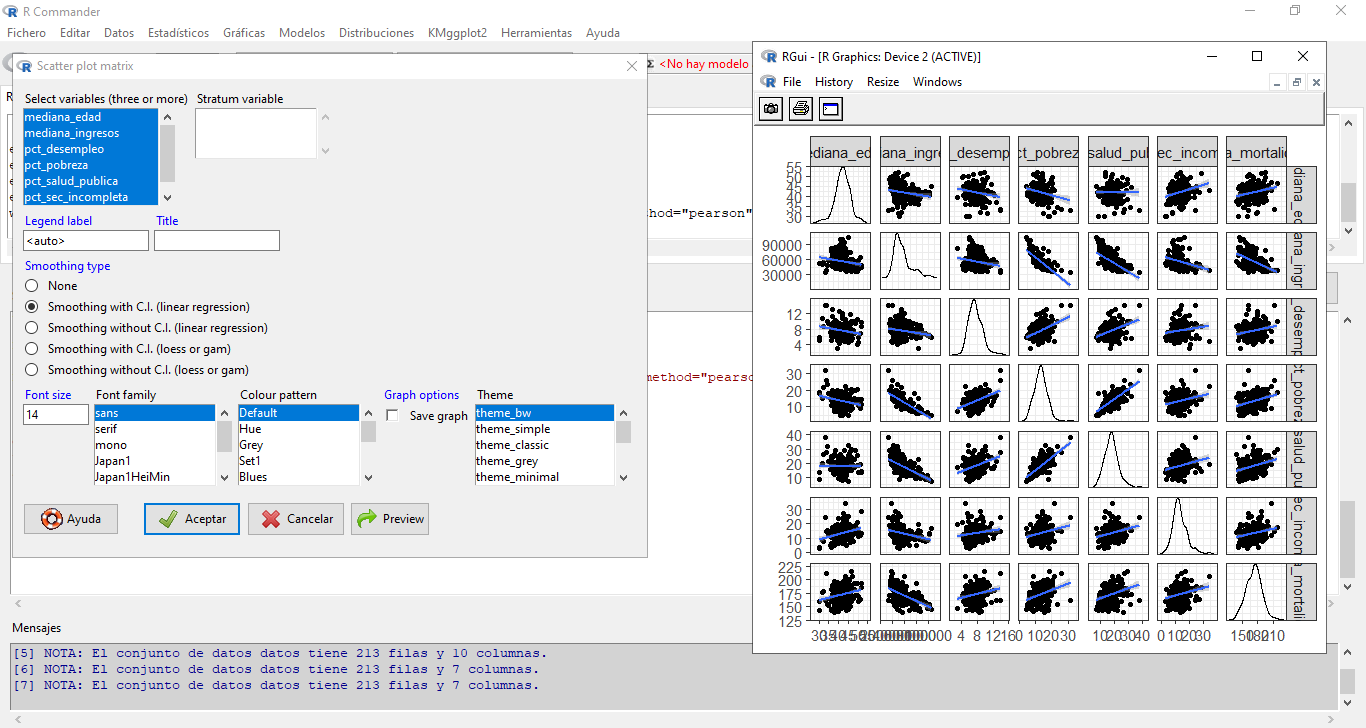

Para visualizar el correlograma escribimos

ggcorr(datos)y presionamos Ejecutar![]()

Aparecerá el siguiente gráfico:

![]()

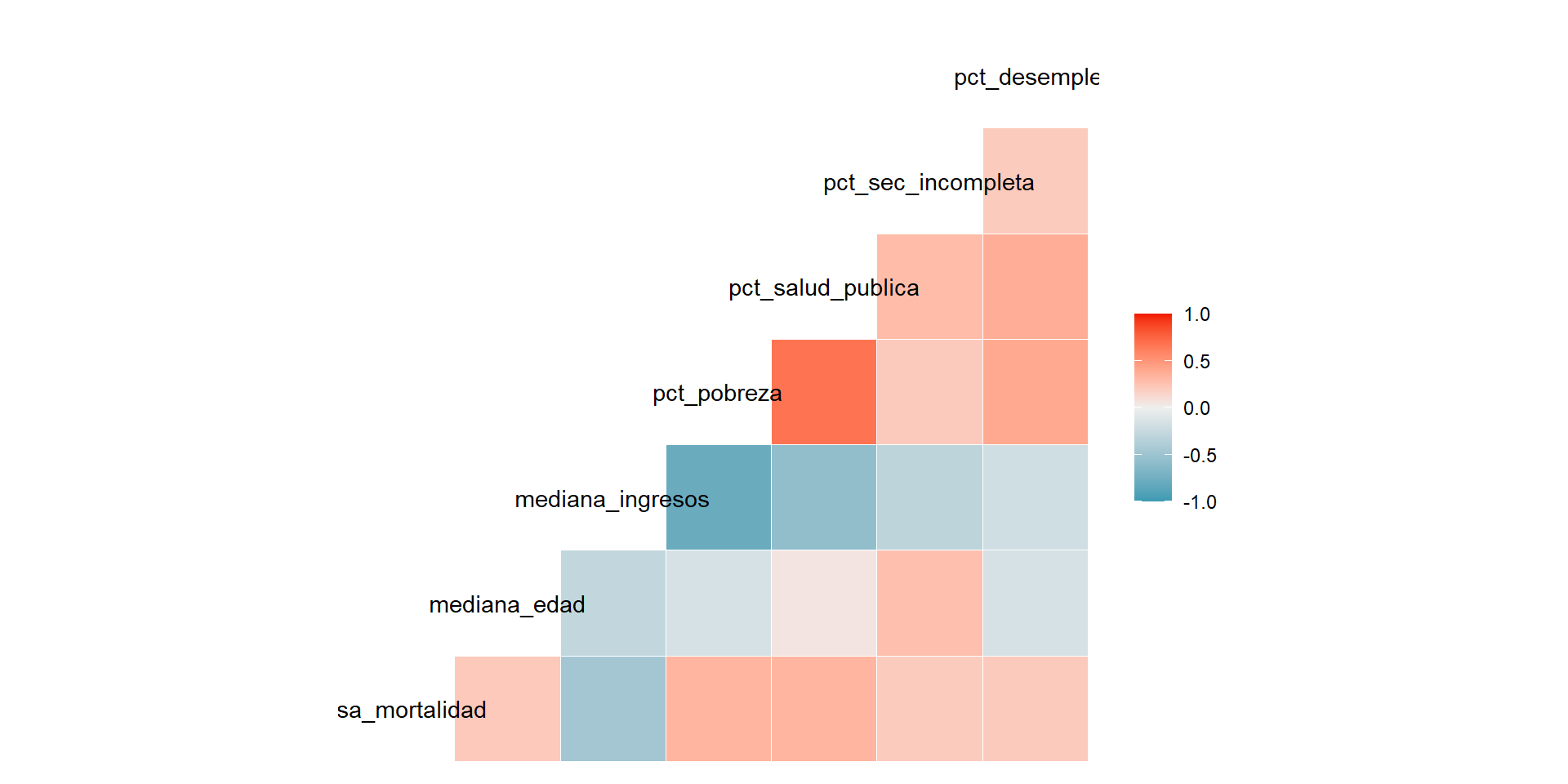

INTERPRETACIÓN

Existe una correlación positiva fuerte entre

pct_pobrezaypct_salud_publica.Existe correlación negativa fuerte entre

mediana_ingresos,pct_pobrezaypct_salud_publica.La mediana de ingresos de la población (

mediana_ingresos) muestra una correlación negativa fuerte con la mortalidad por cáncer (tasa_mortalidad).Las demás variables presentan una correlación positiva débil con

tasa_mortalidad.

Correlaciones no paramétricas

Los métodos de correlación no paramétricos, como los coeficientes de Spearman y Kendall, se utilizan cuando:

Los datos no tienen una relación lineal.

No cumplen con el supuesto de normalidad.

La relación es monótona (creciente o decreciente constante).

Correlación de Spearman (\(ρ\))

Mide la correlación entre dos variables basada en los rangos (orden) de los valores.

Se utiliza cuando los datos no presentan una relación lineal.

Útil para relaciones monótonas.

Se calcula como:

\[ \rho = \frac{1 - 6\sum d_i^2}{n(n^2-1)} \]

\(d_i\) es la diferencia en los rangos de cada par de observaciones.

\(n\) es el número de observaciones.

Correlación de Kendall (\(τ\))

Mide la relación ordinal entre dos variables numéricas en base a la concordancia y discordancia entre pares.

Se utiliza cuando hay datos con valores repetidos o la muestra es pequeña.

Es más robusta frente a datos con valores atípicos en comparación con Spearman.

Se calcula como:

\[ \tau = \frac{n_c - n_d}{n(n-1)/2} \]

- \(n_c\) y \(n_d\) son los pares concordantes o discordantes.

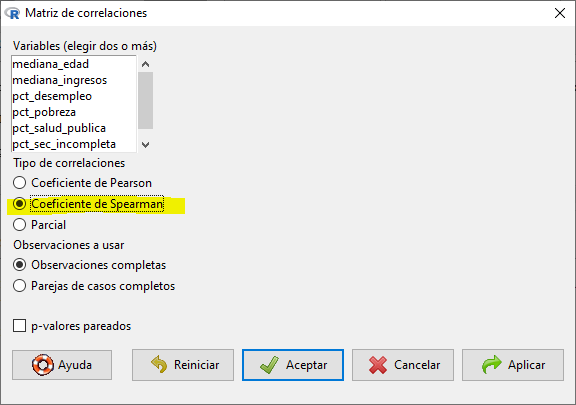

Ejemplo en R Commander

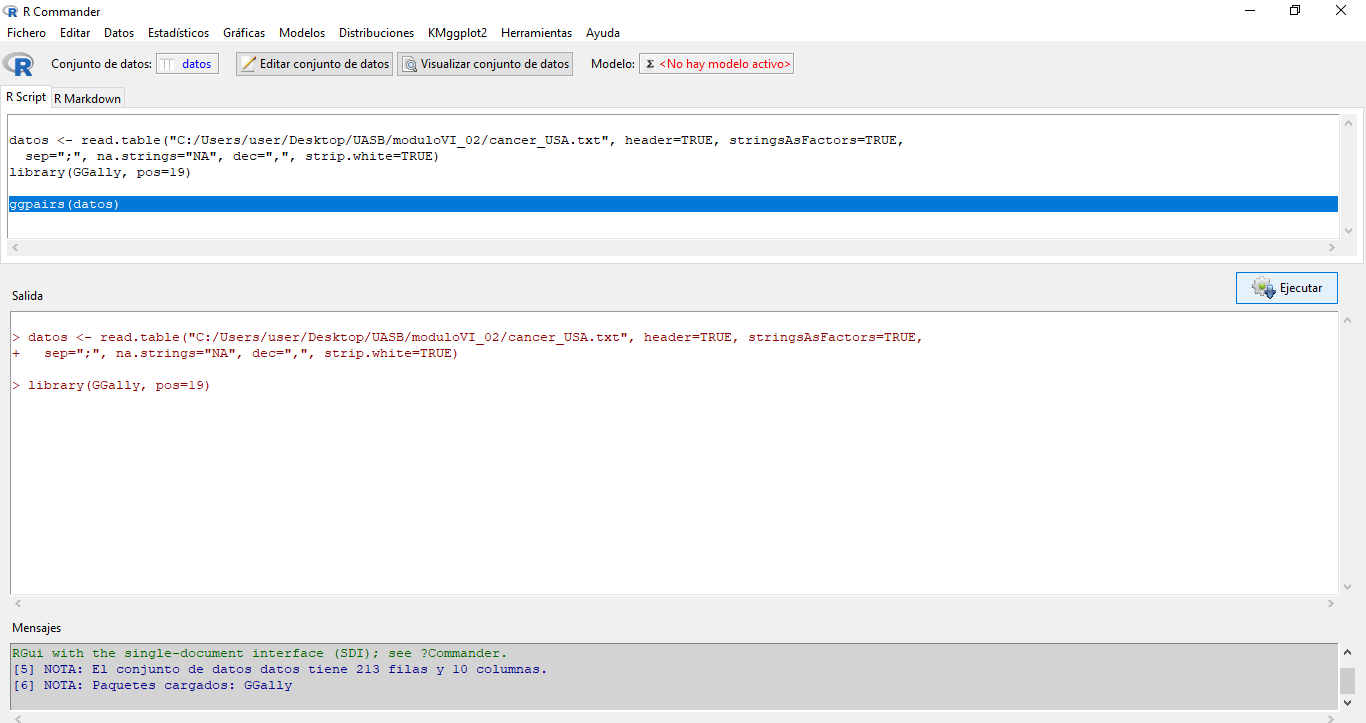

Para comparar variables numéricas mediante correlación de Spearman vamos al menú

Estadísticos > Resúmenes > Matriz de correlacionesy seleccionamos la opciónCoeficiente de Spearman.![]()

Para generar el correlograma de Spearman escribimos el siguiente código en la consola:

ggcorr(datos, method = c("pairwise", "spearman"))![]()

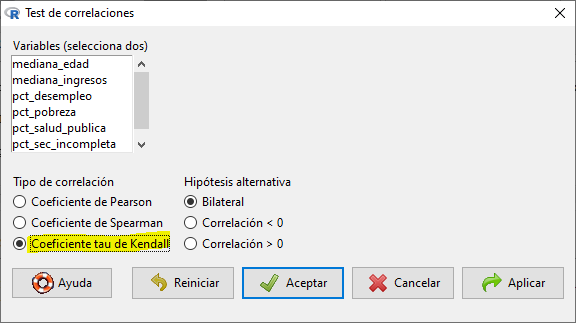

Para correlación de Kendall debemos ir a Estadísticos > Resúmenes > Test de correlación y seleccionar Coeficiente tau de Kendall:

![]()

Para generar el correlograma de Kendall escribimos el siguiente código en la consola:

ggcorr(datos, method = c("pairwise", "kendall"))![]()

y se abrirá una nueva ventana.

y se abrirá una nueva ventana.